〜セルフホストAIエージェント入門〜

はじめに

最近注目を集めている OpenClaw は、

ChatGPT や Claude などの LLM を **自分の環境で常時稼働させる「AIエージェント基盤」**です。

- WhatsApp / Telegram / Discord などを AIのUIとして使える

- ローカル or 自前サーバーで動作(データは自分の管理下)

- オープンソース(GitHubで公開)

本記事では、Windowsホスト + VirtualBox + Ubuntu 24.04 という安全な検証環境上で、

- OpenClaw の概要

- Ubuntu 24.04 仮想マシンの準備

- OpenClaw のインストール

- 初期セットアップ(onboard)

- 動作確認(CLI / Web UI)

までを スクリーンショットを撮りながら解説します。

OpenClawとは?

OpenClaw は、セルフホスト型の AI エージェント・ゲートウェイです。

特徴は以下の通りです:

- Node.js 製の常駐デーモン(Gateway)

- LLM(Claude / OpenAI / Gemini / ローカルモデル)を自由に選択

- チャットツールと直接接続

- 永続メモリとスキル(拡張)を持つ

クラウド型AIと違い、実行環境・ログ・設定をすべて自分で管理できるのが最大の魅力です。

今回の検証環境

| 項目 | 内容 |

|---|---|

| ホストOS | Windows |

| 仮想化 | VirtualBox |

| ゲストOS | Ubuntu 24.04 LTS |

| ネットワーク | NAT(外向き通信のみ) |

| AIプロバイダ | ローカルモデルのOllama |

Step 1:Ubuntu 24.04 を VirtualBox にインストール

※ この部分は既存の手順を利用し、スクリーンショット中心で説明すると良いです。

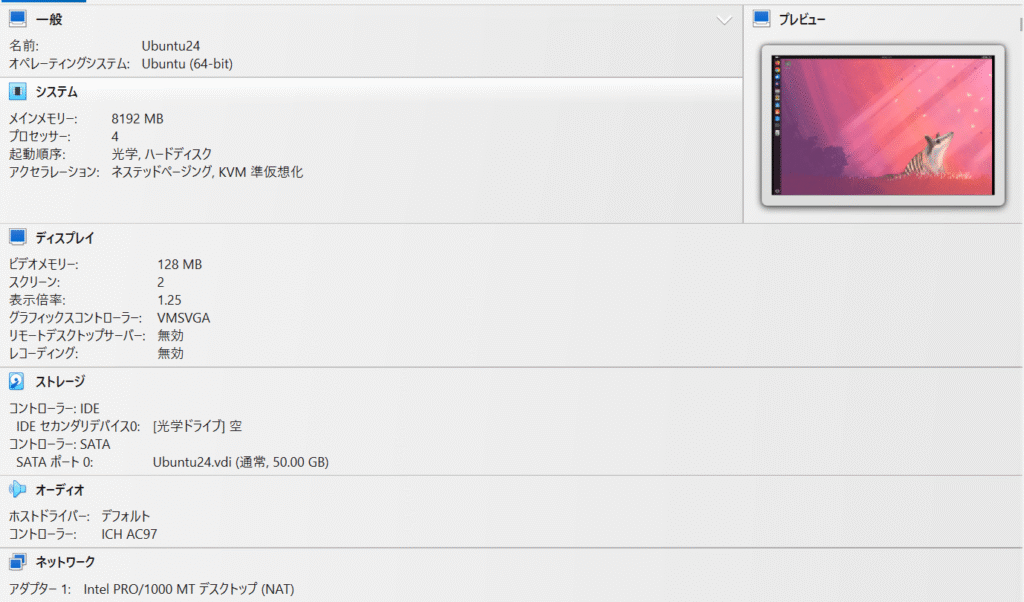

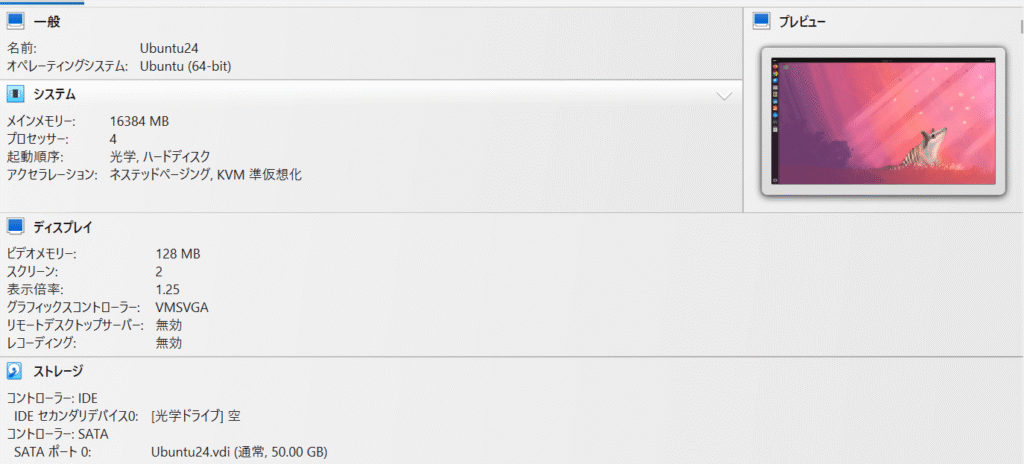

- VirtualBox の設定画面(CPU / メモリ)

OpenclawとOllamaそれぞれの必要スペックと同居するための最低スペックを考えて、メモリを16GBに変更した。

1️⃣ OpenClaw 単体の必要スペック(非常に軽い)

OpenClaw 自体は Node.js 製の常駐ゲートウェイで、

LLM 推論は行いません。

OpenClaw 公式・実測の要件

| 項目 | 最低 | 推奨 |

|---|---|---|

| CPU | 1–2 vCPU | 2–4 vCPU |

| RAM | 1–2 GB | 4 GB |

| ストレージ | 約 500MB | 20GB+ |

| OS | Ubuntu 20.04+ | Ubuntu 24.04 |

| Node.js | 22+ | 24 推奨 |

2️⃣ Ollama の必要スペック(ここが本体)

Ollama は ローカル LLM をロード&推論するため、

RAM / VRAM が支配的です。

モデルサイズ別・最低 RAM(CPU-only)

| モデルサイズ | 最低 RAM | 実用 RAM |

|---|---|---|

| 3B | 8 GB | 12 GB |

| 7B | 16 GB | 16–24 GB |

| 13–14B | 32 GB | 32–64 GB |

| 30B+ | 64 GB+ | 非常に重い |

| 70B | 128 GB+ | 現実的でない |

7B モデルは 8GB では起動しても不安定、16GB が実質的な最低ラインだそうです。

3️⃣ OpenClaw + Ollama を 同居させる場合の結論

最低ライン(「起動して試せる」)

| 項目 | 最低 |

|---|---|

| CPU | 4 core (vCPU) |

| RAM | 16 GB |

| GPU | なし(CPU) |

| ストレージ | 30–40 GB SSD |

| モデル | Ollama 7B(qwen2.5:7b など) |

- ログイン後のデスクトップ

Step 2:前提環境の確認

OpenClaw の公式要件は以下です:

- Node.js 24 推奨(22.14+ 可)

- Git / curl

- Linux(systemd 対応)

Node.js 24 LTS をインストール(NodeSource推奨)

Ubuntu 24.04 で 最も安定・簡単な方法です

(npm も自動で同梱されます)

curl -fsSL https://deb.nodesource.com/setup_24.x | sudo -E bash -

sudo apt install -y nodejsこの方法で Node.js 24.x + npm 11.x が入ります

npm を最新版に更新(念のため)

Node.js 24 には npm が付属していますが、

OpenClaw や pnpm 利用時の事故防止のため 最新版に揃えます。

sudo npm install -g npm@latest確認コマンド:

node --version

npm --version

期待値例(2026年時点):

v24.x.x

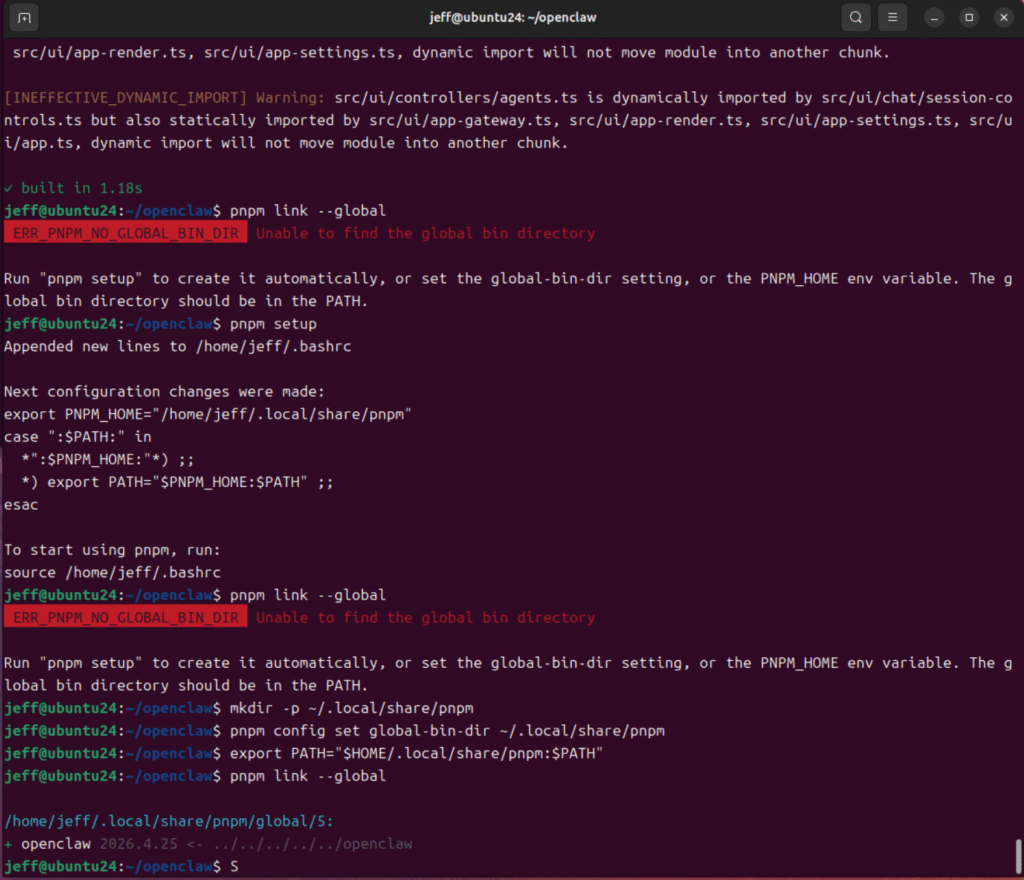

11.x.xStep 3:OpenClaw をインストールする

ソースコードからインストール

git clone https://github.com/openclaw/openclaw.git

cd openclaw

sudo npm install -g pnpm

pnpm install && pnpm build && pnpm ui:build

pnpm link --global- インストール中ログ

- CLI がインストールされた瞬間

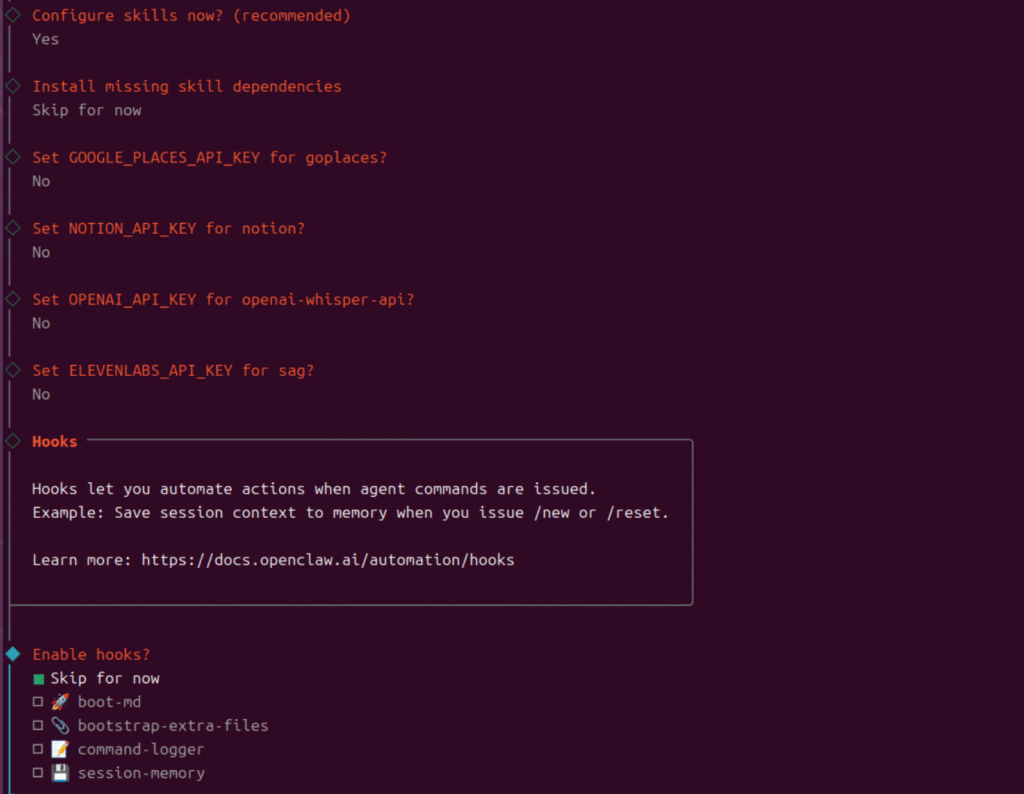

Step 4:オンボーディング(初期セットアップ)

インストール後、自動的に openclaw onboard が起動します

(手動の場合)

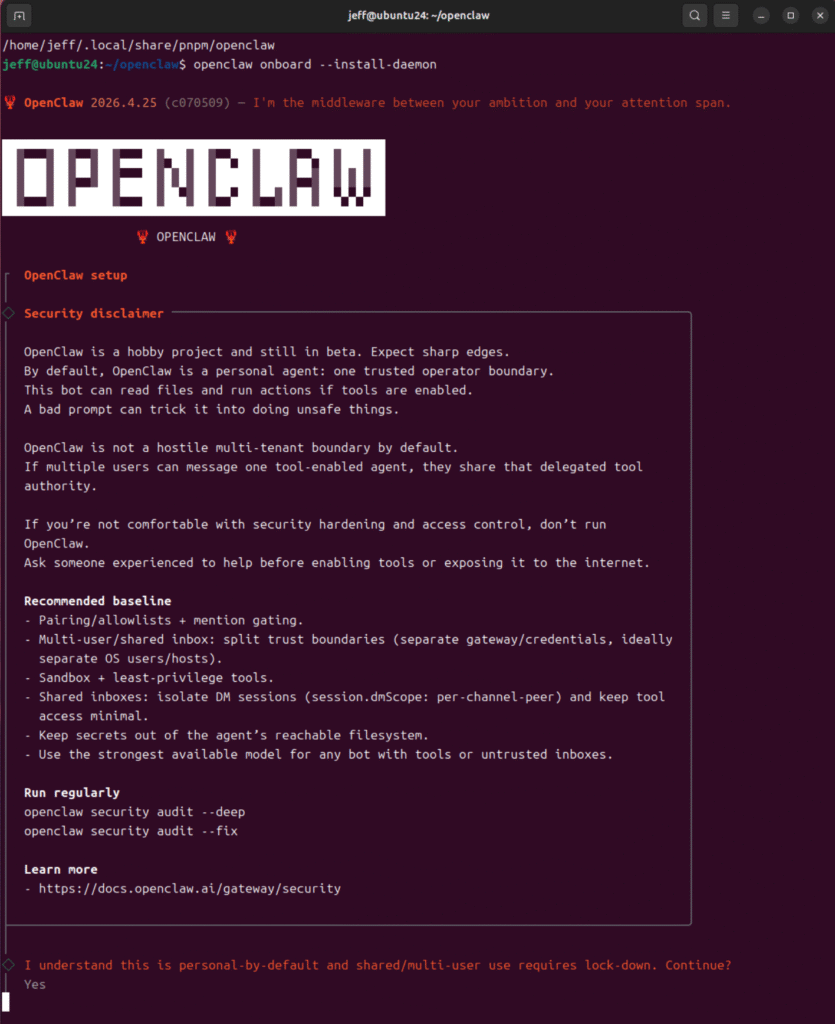

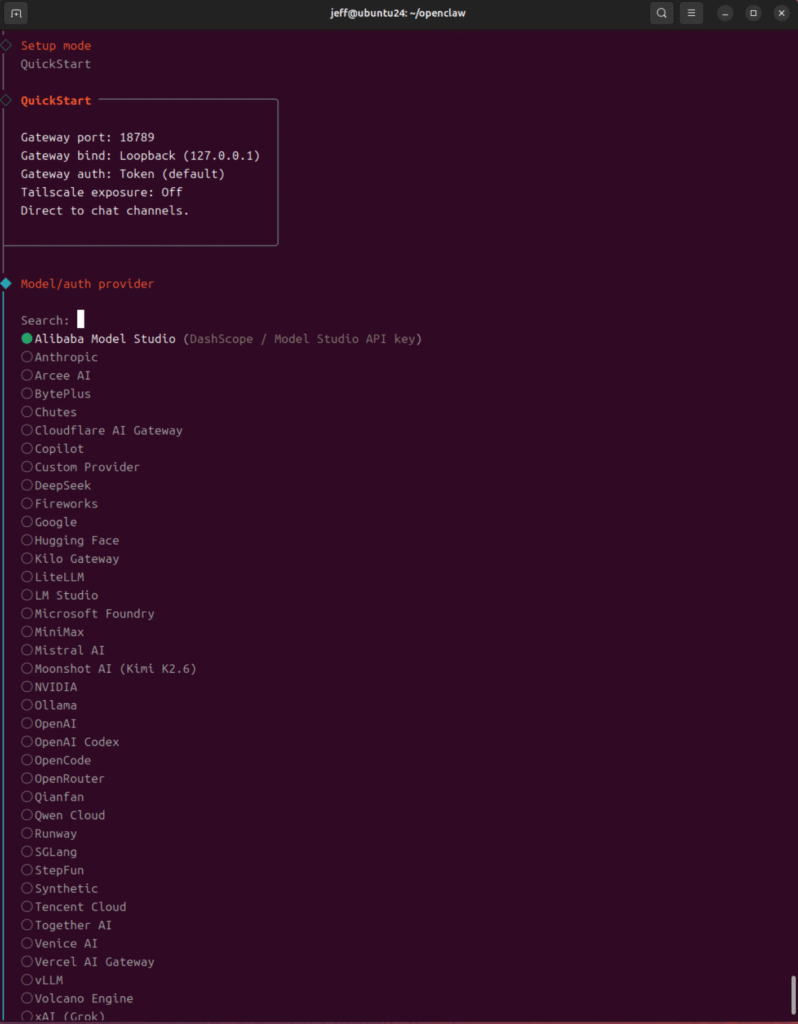

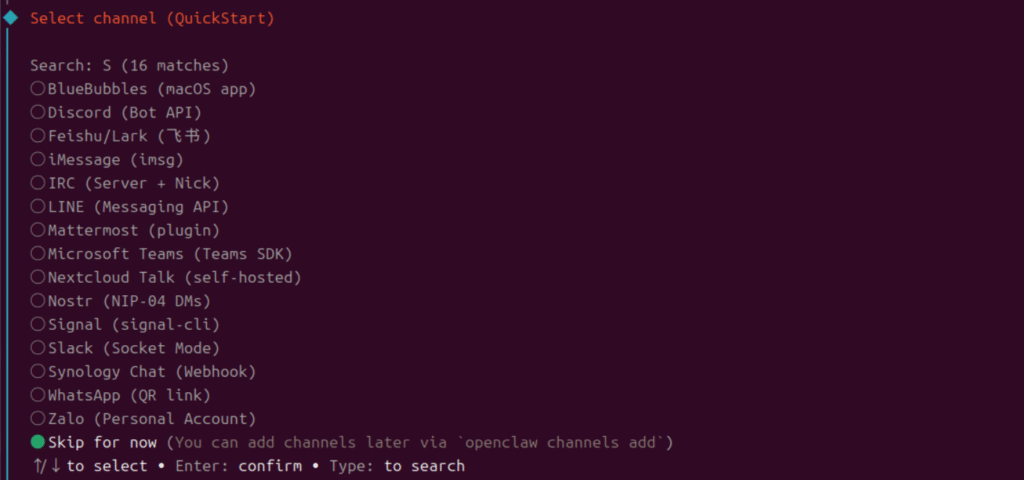

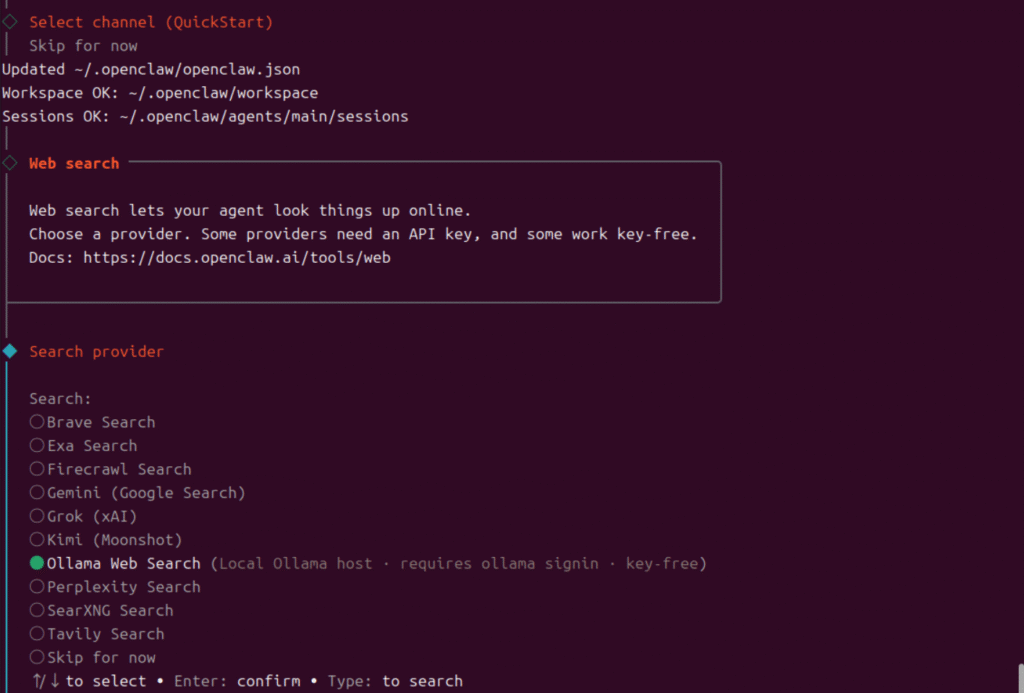

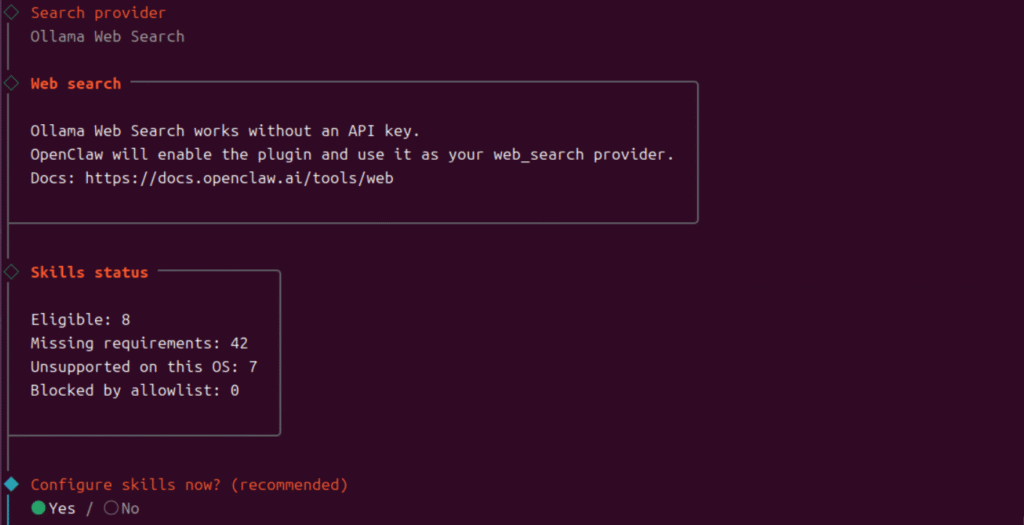

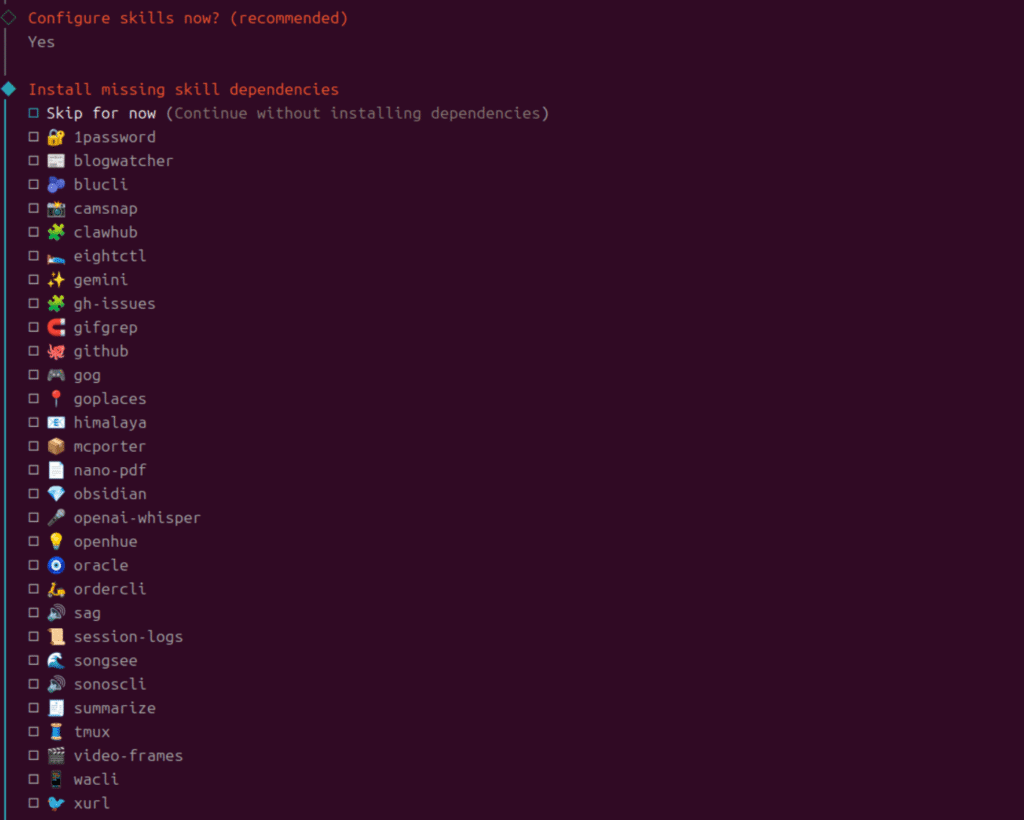

openclaw onboard --install-daemon設定内容(対話形式)

- 実行モード(local)

- AI プロバイダ選択(Anthropic / OpenAI など)

- APIキー入力

- Gateway ポート(デフォルト: 18789)

- systemd サービスとして登録

✅ スクリーンショット推奨

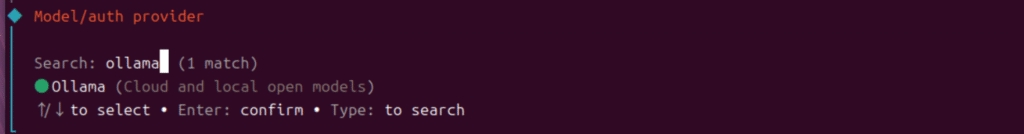

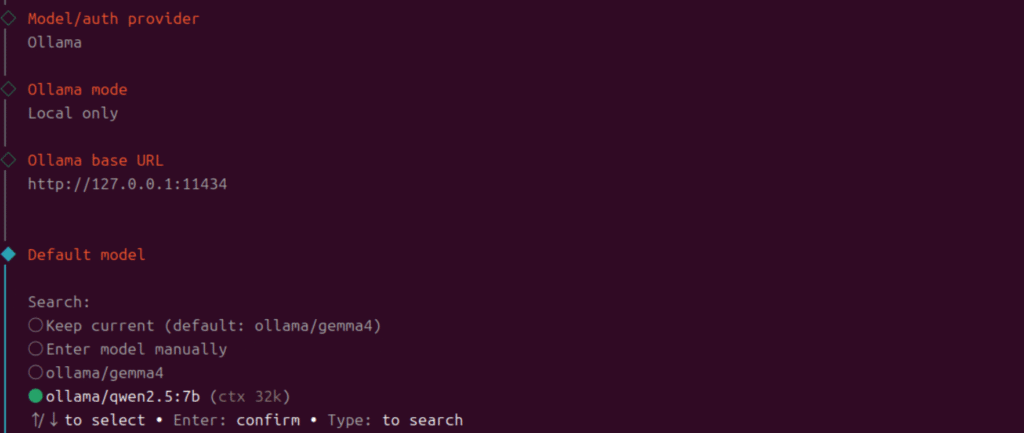

- プロバイダ選択画面

- ローカルサーバーにOllamaモデルをインストール・セットアップすれば、ずっと無料で使える。インストール・セットアップ方法は本ブログの最後に記載している。

- 設定完了メッセージ

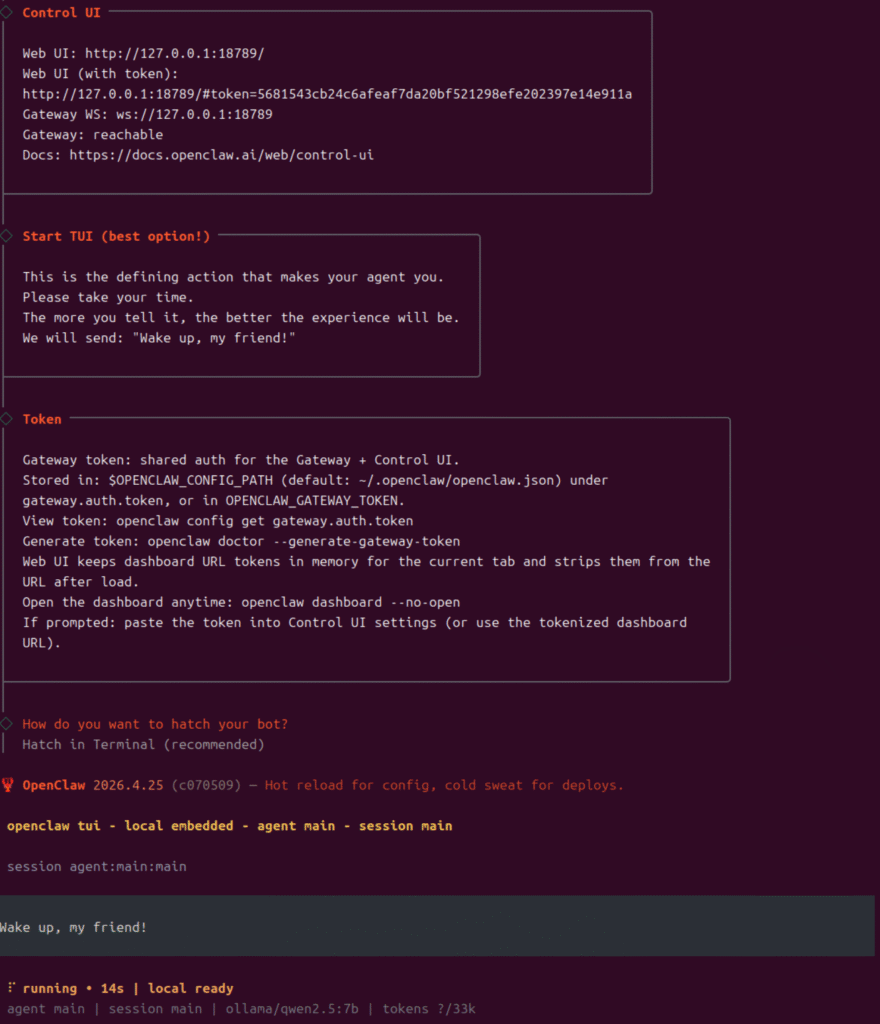

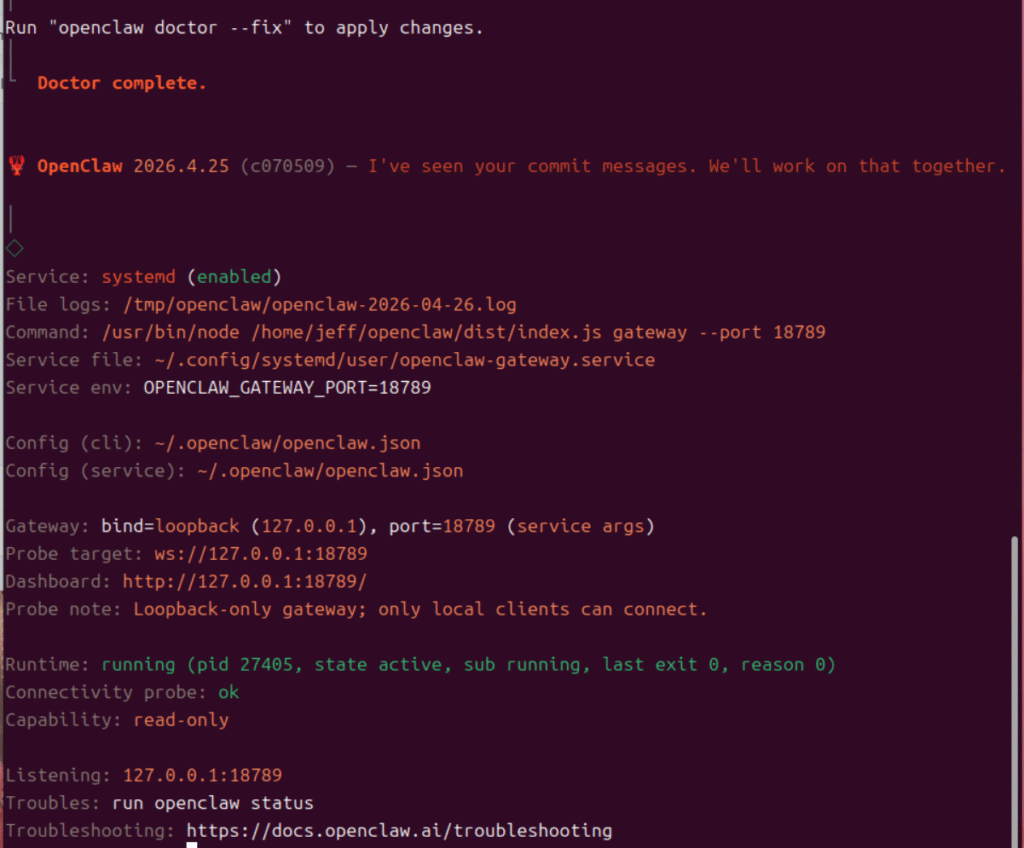

Step 5:動作確認

CLI の確認

openclaw --version

openclaw doctor

openclaw gateway status

正常なら Gateway が running と表示されます

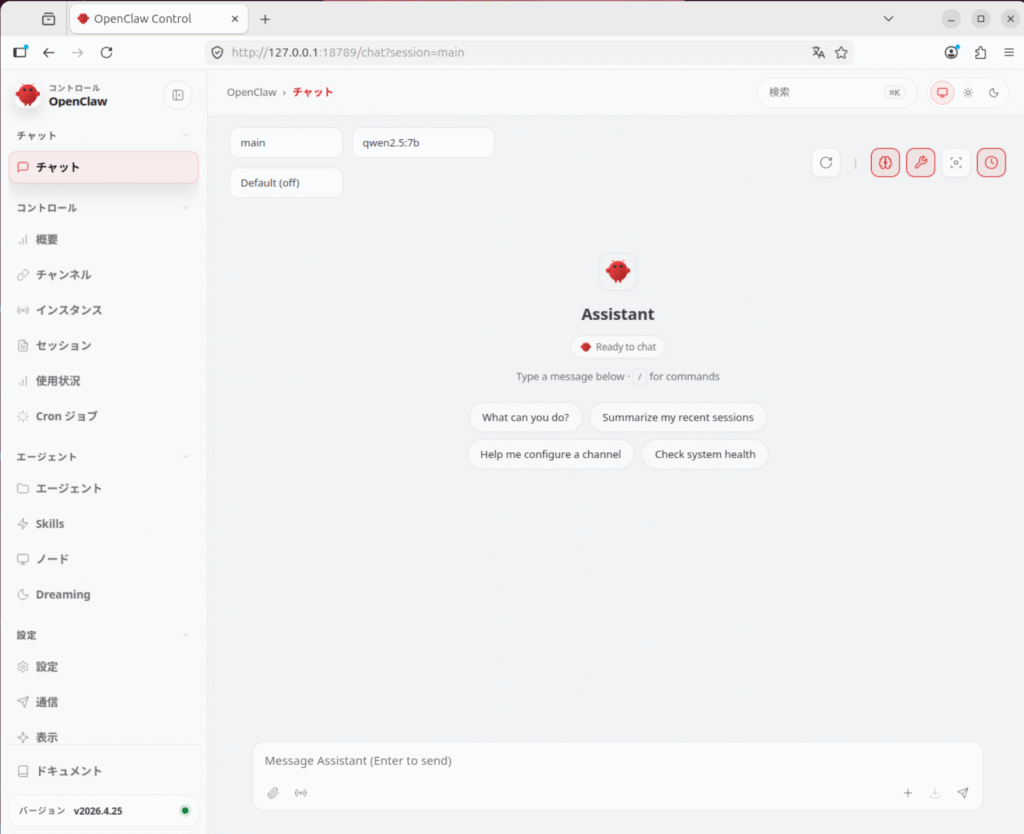

Web UI(ダッシュボード)にアクセス

ブラウザで以下にアクセス:

http://localhost:18789

初回は トークン付きURL で開く必要があります(CLI に表示)

まとめ

OpenClaw は、

- 「AIを試す」から

- 「AIを働かせる」 へ進むための基盤

です。

VirtualBox + Ubuntu 24.04 という安全な環境でも、

10分程度で動作確認まで到達できます。

参考リンク

- OpenClaw 公式インストール

https://docs.openclaw.ai/install [docs.openclaw.ai] - OpenClaw GitHub

https://github.com/openclaw/openclaw [github.com]

Ollamaモデルのインストール・セットアップ

以下は Ubuntu 24.04 上で Ollama をインストール → モデルを用意 → OpenClaw と安全に連携するための

公式ドキュメント準拠・最短で動く手順です。

(これで API課金ゼロの OpenClaw が動きます)

✅ Ollama を Ubuntu 24.04 にインストールして OpenClaw と連携する手順

全体像(先に結論)

- Ollama を公式スクリプトでインストール

- Ollama サービスが起動していることを確認

- ローカルモデルを 1 つ pull

- OpenClaw 側で Ollama を Provider として選択

- 動作確認

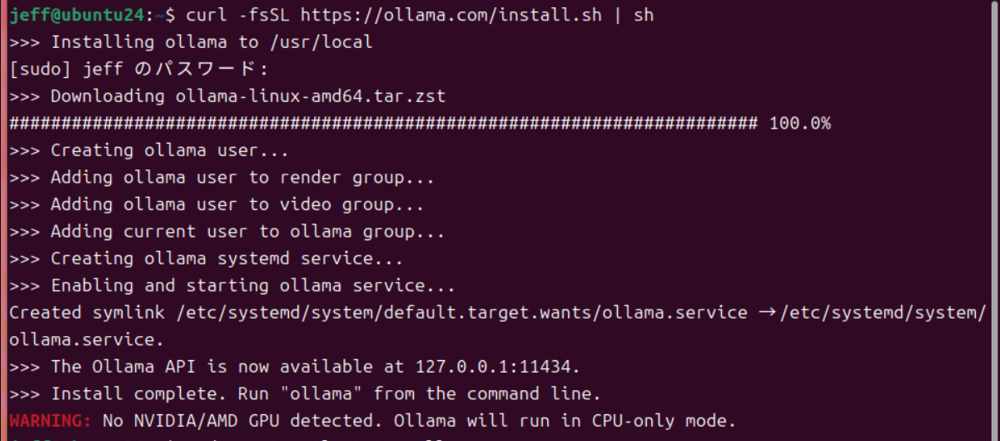

1️⃣ Ollama をインストール(公式・推奨)

Ubuntu 24.04 では 公式インストールスクリプト一択です。

curl -fsSL https://ollama.com/install.sh | shこのスクリプトは以下を自動で行います:

- Ollama バイナリをインストール

ollamaユーザー作成- systemd サービス登録

- 自動起動を有効化

インストール完了時に次の表示が出ます:

The Ollama API is now available at 127.0.0.1:11434

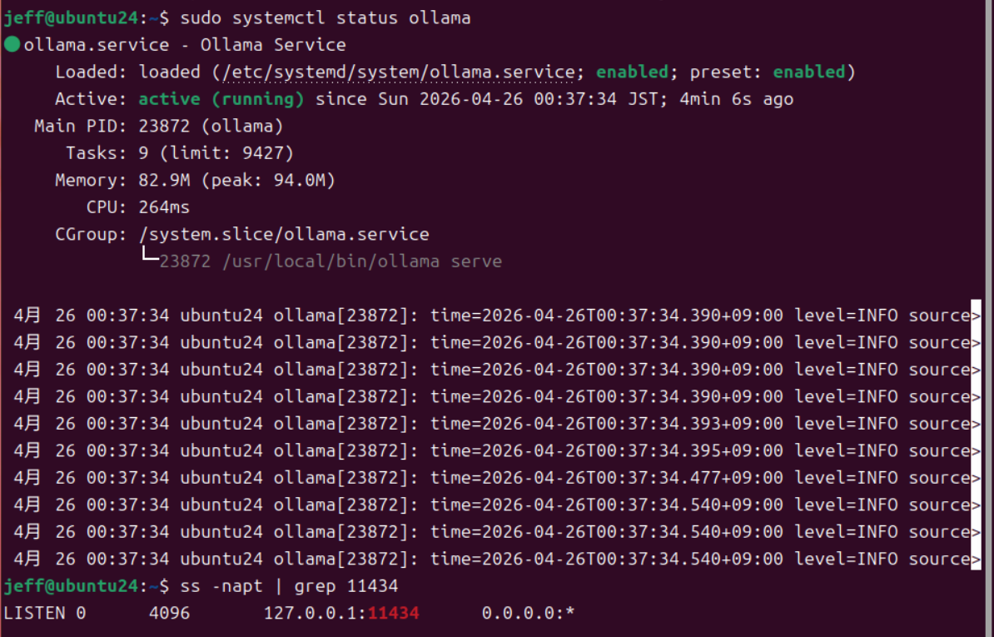

2️⃣ Ollama サービスの状態確認

sudo systemctl status ollama✅ 以下の状態なら OK:

Active: active (running)- listen:

127.0.0.1:11434

ポート確認:

ss -napt | grep 11434

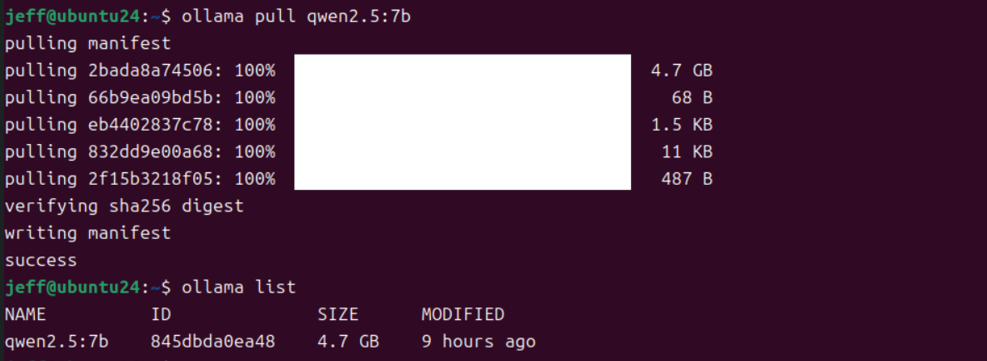

3️⃣ ローカルモデルをダウンロード(必須)

最低 1 つはモデルを pull します。

🔰 まずは軽め&安定(推奨)

ollama pull qwen2.5:7b他の選択肢:

| 目的 | モデル例 | 必要RAM目安 |

|---|---|---|

| 軽量 | mistral:7b | 8–12GB |

| 汎用 | qwen2.5:7b | 16GB |

| 高品質 | gpt-oss:20b | 32GB+ |

モデル一覧確認:

ollama list

ここまで出来たら、Openclawセットアップのプロバイダー選択に、ローカルのollamaを選択できるようになる。

![]()

Leave a Reply